1枚画像からリアルアバターを作る技術を試した

はじめに

コロナの影響でリアルで会えない状況が続いていますが、ClusterやMozilla HubsなどオンラインのVR環境でセミナーやイベントを行う機会が多くなってきました。

そうなると、デフォルトアバターで参加するより何か面白いアバターで参加したいなと思って、自分のリアルアバターに興味が出てきています。

例えば、このようなサービス

うーん、ボーンやリップシンクまで入れるといい値段しますね。

そんな中、Twitterで気になるツイートが流れてきました。

1枚画像から人の高解像フル3D化を実現する研究「PIFuHD」

https://twitter.com/psyth91/status/1272310348805095425?s=20

にわかに信じがたい技術ですが、1枚の画像から3D人物モデルを自動生成できるそうです。

これができれば、リアルアバターを使った会議などの遠隔コミュニケーションが簡単にできそう。

想像するイメージはこんな感じです。

ということで、この技術について調べて、自分の3Dアバターモデルを作ってみました。

PIFuHDとは?

1枚の人物写真から衣服を着た人体3次元モデルを高解像に再構築する深層学習フレームワーク。

指や顔の特徴、衣服のひだといった細かい情報や、見えていない箇所まで3Dで再現します。

南カリフォルニア大学、Facebook Reality Labs、Facebook AI Researchによる研究チームが開発しています。

ベースとなったのは、2019年に発表された「PIFu」(Pixel-Aligned Implicit Function)。

Github

https://github.com/facebookresearch/pifuhd

デモを試してみる

PIFuHDの出力結果を試せるようにGoogle Colaboratoryでデモを公開している。

これだけで自分のObjモデル生成が可能となる。

Google Colaboratory

https://colab.research.google.com/drive/11z58bl3meSzo6kFqkahMa35G5jmh2Wgt

デモの使い方

Twitterに動画を投稿している人がいたので参考にさせていただきました。

https://twitter.com/sasuke9410/status/1272610138180837376?s=20

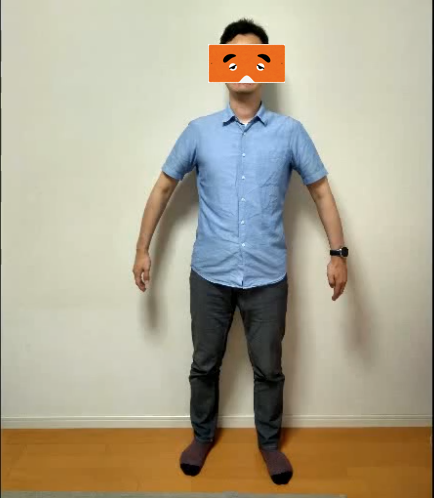

1枚の全身画像をインプットとしてデモを実行

成果物は「obj_path」の場所に格納されています。

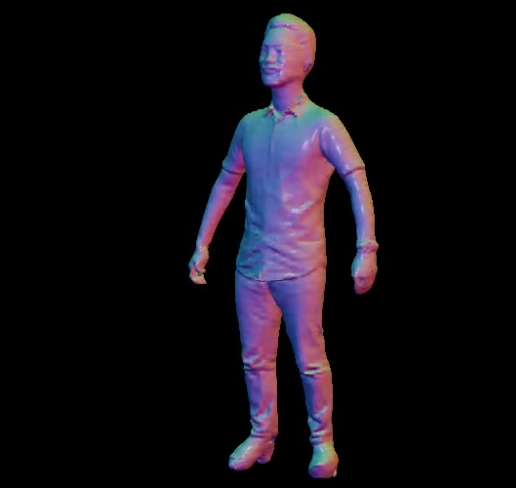

おぉお、リアルアバターを生成できた!

まとめ

1枚の画像から簡単に3Dリアルアバターを作成できてしまった。

デモを実行した結果だけでみると、実用的に使用するには厳しくて、顔が識別できるレベルの解像度が欲しいと思いました。

テクスチャを貼ったり、解像度を上げて生成できるパラメータがあるようなので、環境を用意できれば試してみたい。(Google Colaboratoryではメモリが足りないらしい)

以上です。